你有没有在b站上刷到过像这样的赛博cos t动漫游戏真人画的作品呢?如何让诞生在二次元世界里的角色人物拥有完整的一生啊,不一副存在于真实世界里的面孔呢?让ai来帮你吧。这里是哪里?一个不会画画的设计师,兴趣爱好是做一些你能学得会的教程。你现在正在收看的是我们stability cussion零基础入门系列的一阶进阶课。作为一款完全开源免费强大的a i i i应用,它不仅能让你喜欢的人物角色打破次元壁来到真实世界,还能一键换皮肤换场景,实现角色的人设理会自由。你对这些东西感兴趣吗?如果是,那这期教程一定会对你有很大帮助。在接下来的十五分钟里,我们将一起探索stability version中的control t s i二模型的作用原理与基本用法,学习使用它实现真人化转会、线稿填色、三维渲染等各种神奇操作,并拓展结合i p o sector in paints的模型,实现进阶角色二创的方式。所需的所有插件模型,我都为你附上了下载地址。教程内容很难也很充实,你可能需要看不止一遍,我建议你先收藏一下再开始学习。

准备好就让我们一起开启这节课的a i真人化之旅吧。要想将一个二次元的人物角色三次元化,最简单的方式就是对角色图片进行图生图。我们在一整系列的开头就介绍过图生图的原理。a i会在一张原图的基础上加燥模糊原有的色彩形象,再根据模型提示词和参数设置进行不同姿势的去噪,将它转换成一张全新的图片。有一些a i模型被投喂了大量的角色照片,因而可以准确生成真实世界的人物形象。在他们的帮助下,你就可以得到一张三次元版本的角色照片了让我们来梳理一遍基本操作。由于本期节目获得了微星显卡的赞助,所以我拿他们新上市的万图师g force r t x四零六零钛十六g版本显卡的代言人万图娘来做操作示范。它的步骤大致可以划分成三步。

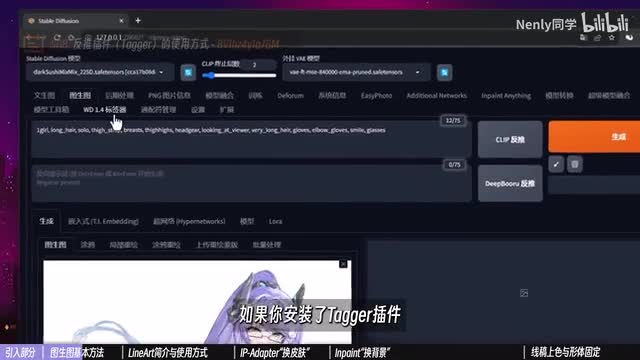

第一步,挑选一张合适的角色原图,打开s d的图形图标签,将它导入图片区域。第二步,填写提示词,尽可能详细的描述角色。你可以凭借你对于角色的了解自信撰写,但我更推荐你使用自带的deep borrer功能对图片进行反推,它会自动识别图片内容,并将它总结成一个个内容标签,进入正向提示字框中。如果你安装了。插件也可以使用独立的反推模型来实现。记得在反推完以后再人工检查一遍,将那些不太符合要求或者你觉得不合适的描述去掉,保证生成准确。第三步,选择合适的大模型,这里面使用高质量的真实性微调模型是做出效果的关键。你可以根据你的角色面容特征选择合适的模型。

这几个我为你推荐的都是一些非常受欢迎的人像模型,你可以在简介里找到他们的下载方式,完成以后设置包括尺寸、采样方法在内的各项参数。一个要点,进行角色真人化时,为了保证结果与原图足够像,一般的重绘幅度不应该大于零点五。点击生成你就会得到一份它的三次元写真了,你觉得效果如何?这里也暴露出了一些图层图的显著问题,加噪去噪的过程会让原图变模糊,导致很多三次元化以后的细节是对不上号的。比如人物的眼镜、衣服是肚子上的啥玩意儿。如果想要生生成的结果了,你就需要加大力度,对i生成的过过程中更多约束控制。比如我说你应该也知道该上control net了。之前我们学习了很很多生态的扩展用法,它可以制。ai绘图中的人物姿势,丰富画面细节,给老照片修复上色,甚至用来制作一些有趣的图片。

经过了几轮更新,目前它拥有将近二十种控制类型,以及数不清的新模型和预处理器,但有一个几乎无所不能的模型是我觉得你一定得掌握的,它就是我们今天的主力选手line art。它脱胎于control t一点零版本kenny本质上是一种基于边缘线条的图像控制引导相关的预处理器,可以从图片中提取边缘轮廓特征,形成这样的一幅线条信息图。没错,就像是原画插画师起草作品时的线稿一样,然后再用它来指导新的图像生成,从而固定形体与细节特征,基于这一特性,它还有很多奇妙的用法用途,看完这期视频你就会知道它的威力所在了。在刚刚提到的这三步的基础上,我们新增第四步。在最下方激活c t r l e t并勾选完美像素模式,选择line二次的预处理器和模型。在最新版的c t r l e d图上图中会默认使用你导入进来的原图来提取信息。如果你想另外上传图片,就选中这个选项,再拖图片进来。那我们现在不用lie二次的预处理器有很多种。

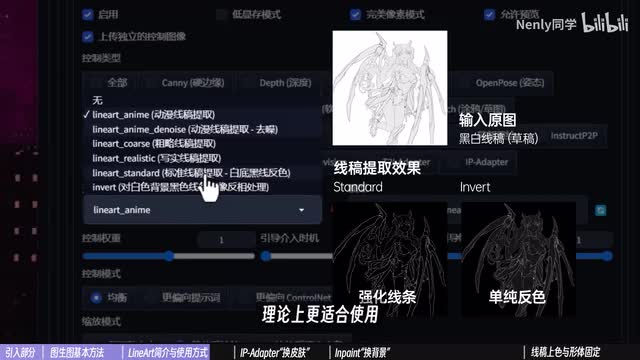

这里我们选择用于提取动漫线稿的anim,它们的详细区别我们会在大约半分钟以后就讲到。维持其余的各项参数不变,再点击生成,看遮瑕的效果是不是就准确自然多了。在有了线条的指引以后,ai能够更细致的识别发丝的纹理,衣服的剪裁,甚至是飘带末尾的甲方logo都能精确呈现。但要确保效果的完美,就必须准确选择线稿图取的类型。这里就涉及到了我们刚刚看到的各种不同的预处理器。在有导入图片的情况下,选定一个预处理器以及旁边的爆炸的按钮,可以看到它的预处理的结果,也是提提取出来的线条的模样不同预处理器会以不同的算法逻辑识别图片的线条,自然会有效果的差异。二次元的真真的a m m e e这两项就对了。有去噪的这个线条会稍微精细一点。

如果你想从真实照片里提取线条特征就选realistic。用这种方式提取的线条特征也常常会被用在一些真人转动漫的操作里,和我们刚刚讲到的流程是完全一致的。standard和invert一般被用于真正的白底黑线线稿图,他们都会起到一个类似于反射的作。将控制图转换成a i能识别的黑底白线形式,这里面standard会强化润滑部分线条,理论上更适合使用。最后一个粗略挺少用的,但在你想要适当放松控制效果,赋予a i更多创造力的时候,不妨用用看看。这些类型虽然不复杂,但你要牢记他们的区别。如果选错了类型,就会让识别的线条模糊,无法让a i准确识别并还原形象。从这个对比里你应该就能够看出来,在对真人照片使用anime识别的时候,就容易产生线条拧成一团,从而导致画面粘连的情况,不利于我们呈现内容。

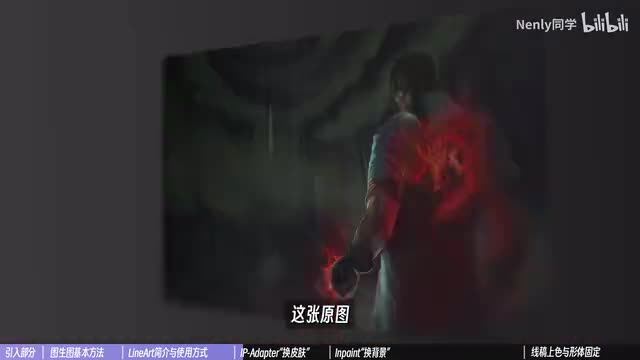

以上就是line二次模型的基本使用方式了,你掌握了吗?会的差不多了,就在弹幕敲一个六吧。但如果这期教程到这里就结束,未免也太没有意思了。所以我为你准备了一些更为刺激的玩法,不仅可以帮助你全面的了解line二二在实战中的作用,还可以顺带掌握一系列全新的control net模型,掌握利用它们对角色进行复杂二创的方式。同一个角色拥有不同的外观特效的皮肤,这在一些游戏里还是挺常见的对吧?这张原图我们就把它定义成角色的原皮吧,想要更酷炫更独特一点。a i的帮助下人人都可以成为非常厉害的皮肤设计师。这就是我给万度娘设计的一款星空主题的皮肤。卖两个硬币不过分吧,看上去还挺复杂的,但把它设计出来只花了我不到五分钟的时间,你想知道我是怎么做到的吗?这一切要归功于i p adapter这个全新的控制模型。i p adapter是一个由腾讯ai实验室开发的图片生成项目。

在s d里我们通常只能够通过提示词来向a i传递一些关于内容的提示。虽然有图生图的功能,但它并非一种真正的提示,只是塑造一种色彩上的相似性。在这期视频的一开始我们也分析过了,而i p adapt的好处就在于它会真正的理解你输入的这张图片的含义。在这里他学习到的的东西去微调输出结果。而而结果和你输入的这张参考图更像,从色彩形象到内容意境都会更像。而且它它和一些其他控制模型组合起来的时候,就可以起到一个非常好的风格迁移的作用。这套皮肤的设设计过程和展展示一下,你是知道怎么做了。他在设计的过程中,设计师会浏览大量设计作品。

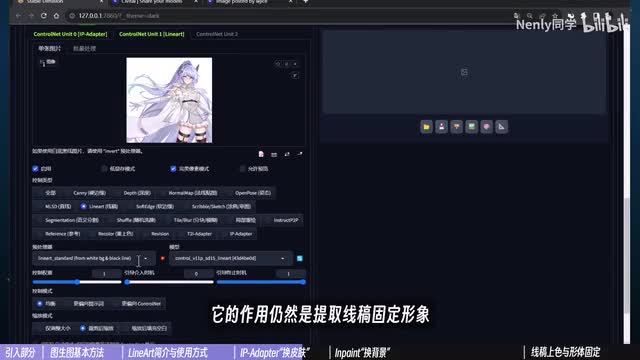

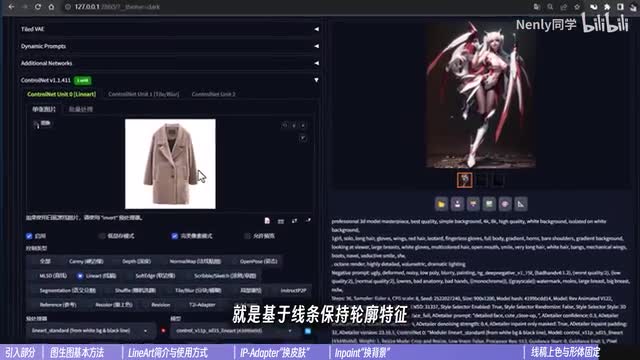

来发掘灵感。这个皮肤的灵感也正是来源于这样一张星空插画,将它保存下来,然后回到s d里,我们切换到文生图窗口,在controller的第一个unit中导入我们的灵感图,然后选择i p adapt的控制模型。为了防止a i过度学习,我一般习惯把权重与引导结束部署调低到零点八左右。随后切换到第二个unit,导入角色原图开启。line art anime. 这里它的作用仍然是提取线稿,固定形象,只不过目的不一样。刚才是为了让真人化以后的人物和原来足够像,现在则是为了让换完皮肤以后的角色和原来足够像,最后选择一个和原画风格相近的二次元模型。按之前的方式设置好参数,写好提示词,你也可以在提示词里适当补充与这个灵感相关的一些描述。点击生成一款主题皮肤就被做出来了。

是不是真的挺快的?用类似的方式,你可以源源不断的将你的想法和灵感借助a i的力量转化为不同的视觉特征。比如自然主题的、流水主题的、花瓣主题的,只要找到不错的参考图,你就可以不花一分钱,你入到到到贵贵的了从。网上下载下来的角色例会背景一般比较简约单调,为什么不给它加个背景,让它变得更加生动呢?给人物角色换背景也是许多朋友一直以来感兴趣的一个小技巧。你可能会想到局部重绘,没错,像这种改动画面局部的操作,最直接的方式一定是重绘。对于比较简单的人物形象,你可以用手画蒙版的方式重绘。不过像这种动作比较复杂,又有很多小缝隙的图片,手画明显不是一个很人道的选择。这个时候我就更推荐你上传蒙版重绘了。具体的操作我在系列课第七课里做了详细的讲解。

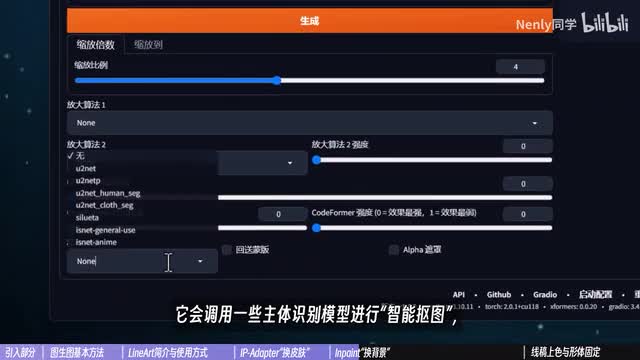

会会photoshop的话,把它从背景里抠出来,生成一张蒙版图并不难。但如果你和我一样懒到希望在s d里足不出户就解决所有工作。可以求出一个叫做remove background的插件。安装好以后,你可以在后期处理窗口的最下方看到它它会调用一些主体识别模型进行智能抠图。理论上它会自行下载所有所需的模型,但因为网络原因经常下载失败。这个时候你可以查看命令行将所需的模型手动下载并放置在屏幕上。这个我为你列举出来的对应位置就可以发挥作用了。顺带i t为了防止你下载。

不了,我也在网盘里都塞了一份,我们要操作的是二次元人物,所以我会推荐你使用下面这个easy alam。因为不用放大,将缩放比例设置为一,点击生成它就会自动为你抠出一张透明底的p n g图片,非常轻松。如果只需要在s d里重绘,就勾选这个背诵的模型,并且生成这个模板。左右它就会出一张张用于蒙版绘绘黑黑白蒙版图,然后重重重重重别把原图蒙蒙版图传到对应位置,选择重绘的模版区域,并且将内容处理方式选择为填充,然后重重幅度拉满,在提示词里面写写背景里面的内容,记得把和有关的描述词都勾去掉,点击成成背景就被添加上去了。在这个过程中选择填充的处理方式,可以让场景的色调与人物更接近,而选择空白请空间则容易生成反差比较大的背景。那你发现了吗?这样生成出来的背景总是显得有些杂乱抽象,并且和人物好像没有什么逻辑关联。为了解决这个问题,我们也可以用用t r l l里的局部重绘模型。它可以帮助我们在重绘的时候加强重绘区域内外的关联,从而实现从色彩过渡到内容的和谐自然。

在使用蒙版。进行重绘时,你不需要单独上传控制图像,也无需进行其他操作,把它勾选打开即可。在几种不同的预处理方式里,我们一般都会选择这个全局和谐。这样画出来的背景在空间和构图上都会适当照顾已有的人物形象,多跑几次一定会有让你满意的画面呢。但是纯靠抽卡实在是太不稳定了。有另外一种更为可靠的思路是找一张想要换上去的背景图,然后借助c t r l e t把它自然的变在人物的下方。和普通的科幻背景还不一样,a i可以真正意义的让它成为画面的一部分。我们在旁边再开一个control net,把要替换的背景图加进去,并加载line二预处理器。

没错,万能的line二甚至可以帮我们把背景的形象也固定在画面里。和刚才讨论的一样,什么样的图片选择什么样的预处理器,i p a c e模型也保持打开,点击生成,它就会按照上传图片的模样把背景画到里面去了,还蛮神奇的对吧?上面这两个小技巧不仅仅可以运用在角色的二次元例会上,还可以用来加工真人化以后的版本。你可以选择先把它变成三次元的,然后再做风格化换背景,也可以拿不同皮肤背景。片去做真人化,上面的几种方法都掌握牢固的话,对你来说就是条条大路通罗马了。在这些操作流程里想要取得更好的效果,一般都需要多开control net来打配合。除了我们提到的ip adaptor pints的模型,在实际的操作中我还加入了open pose来固定人物姿势,画好手部细节以及depth来让背景更加富有层次感。更多的control net往往就代表更精确的控制效果,更多样的绘图玩法以及更大的显存需求。在我的实际测试下,开启三重controller,绘制一千像素左右的图片就能吃掉十二g以上的显存。

显存不足的情况下,c p l d l i n的出图效率就会大大降低,也容易爆显存报错。想兼顾高清高质量的图片输出,又想靠多重count来丰富你的创作,这个时候你需要一款性能足够强大,度量也足够宽广的显卡。万图娘的角色灵感来源于微信旗下的万图师系列产品。在一直挺喜欢cont师这个名字的。它给我一种在分秒间就可以变得千万张图片的感觉,和我们今天利用ai去创作出无限的可能性一样。这个系列最近新推出的四零六零零一六g显存型号,非常适合ai pt t这种显存有。强需求的生产力场景。它搭载的第四代tensor co极大的增强了高效能a i运算的能力。

放到stability fusion里不仅能完美流畅运行多重可穿戴的复杂工作流,还能支持二k以上分辨率的商用级图片生成,让你的作品质量得到飞跃。在s d excel正在逐步普及的当下,也能支持你灵活运用各种更加强大的图像生成模型。十六g的显存在大模型微调,laura训练上也能更加游刃有余。富有工业美学的外观设计,小巧轻便的双风扇结构,都有可圈可点之处。当然除了用来跑图以外,拿来满足一些日常娱乐需求也不在话下。什么光线追踪、b o s s三等等不用介绍,都是传统艺能了。对于侧重显卡核心功能的创作型用户,它一定是一个非常适合且高性价比的选择。关于line二的有趣玩法还有很多可以应用的范围,场景也一定比你想象中要更加辽阔。

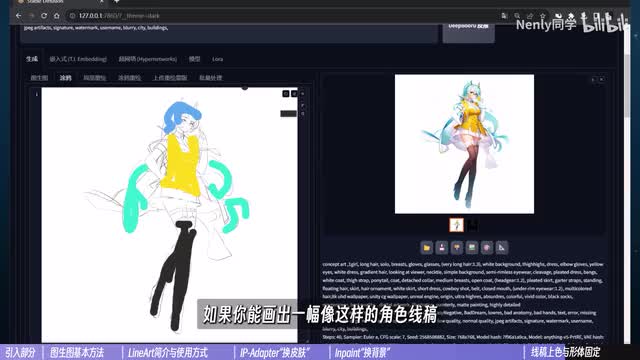

一个最早被开发出来的核心用途就是给插画原画的线稿上色。传统绘画流程中,会先用简单的线条勾勒人物角色的大概形象,在进行上色、填充、细节修饰这些精加工环节,需要花费大量的时间精力。对配。色光影进行细致的把控。但在ai出现以后,他们或许要变成整个流程里最简单的一环了。我上微信要的几张外部呢在设计阶段的线稿草图很潦草对吧?但以后画师可能只需要画到这一步就够了。在文章图里把这张线稿加载到c t r l e t里。预处理器选standard还是按刚刚的方式选择合适的模型,写好提示词,看不出几秒钟的时间a i就帮你画完了。

只是上传一张线稿的话,那生成的颜色肯定会具有一定的随机性。但如果你有明确色彩预设,例如头发是什么颜色,衣服是什么颜色,可以考虑利用s d里的涂鸦功能,用画笔去测在对应的地方。简单多么?我知道画的有点抽象了,但你要相信a i鉴赏艺术的能力,把重绘幅度控制在零点七到零点八左右,点击生成颜色就会填到对应的位置了。我承认这个示范有点整活的成分在,如果你能画出一幅像这样的角色线稿,那对p s一类的设计软件操作肯定不生疏。所以也可以是在其他软件里借助更高效的工具完成这个过程。从这个角度说,它也可以变成一种上色流程的优化工具,定义好大的色块。模型以后细节交由ai来丰满,真的可以极大的减轻画师们的后期工作量。而它不仅可以给绘画作品上色,还能从线条图渲染出逼真的三d c g,甚至生成高清的摄影大图,一步到位的实现开头我们做过的真人化操作。

实现这些效果的方法和开头介绍的完全一样,只需要在重绘的时候选择对应风格的模型或lora,再在提示词里加以强化内容就好了。这些操作本质上都属于一种线上一样,只不过你在这个线条里面的东西变成了三维模型的材质或者真实的五官设计。能想明白这一点,来二在你这儿就真的无所不能了。第二次的另一大主要作用就是基于线条保持轮廓特征展开去讨论。同样有比较多的应用场景,比如应用在服装设计产品设计里。一些基于成熟的思路是借助line二次的线条固定产品结构,再通过i p adapter一类的手段改造产品的配色结构,进行风格迁移。就好像刚刚我们给角色换皮肤一样,看做一个联名款的显卡好像也没有这么难吧。这些线条看似简单,但却是所有视觉形象传递。

根基未来的原画设计、建模,甚至是摄影后期行业,可能都会受益于这些ai工具迎来新一轮生产力的进化。以上就是本期教程的所有内容了,希望可以通过这些有趣的案例,帮助你轻松愉快的掌握line us和i p adapter这些新模型的用法。如果这期教程对你有帮助,请别忘了一键三连支持一下,也可以关注我的账号,蹲守更多使用教程。也再次感谢微信对本期视频的大力支持。如果你对这款万头娘代言的g force r t x四零六零零venus二x plex十六g o c感兴趣的话,可以在各大平台的微星显卡官方授权经销商及线上旗舰店找到购买方式,让他为你激发更多的a i创作灵感。这也是南美,感谢你看到最后,我们下期再见了,拜拜。

刺鸟图文助手

刺鸟图文助手