在基础篇中我们和二狗子一起学习了康复u i的虚拟环境部署基础节点和自定义节点的安装方式,l c m加速country net应用以及提示词模板,反对提示词图生图和投屏交互等基础工作流的搭建。这样看来我们好像一直在枯燥的学习。

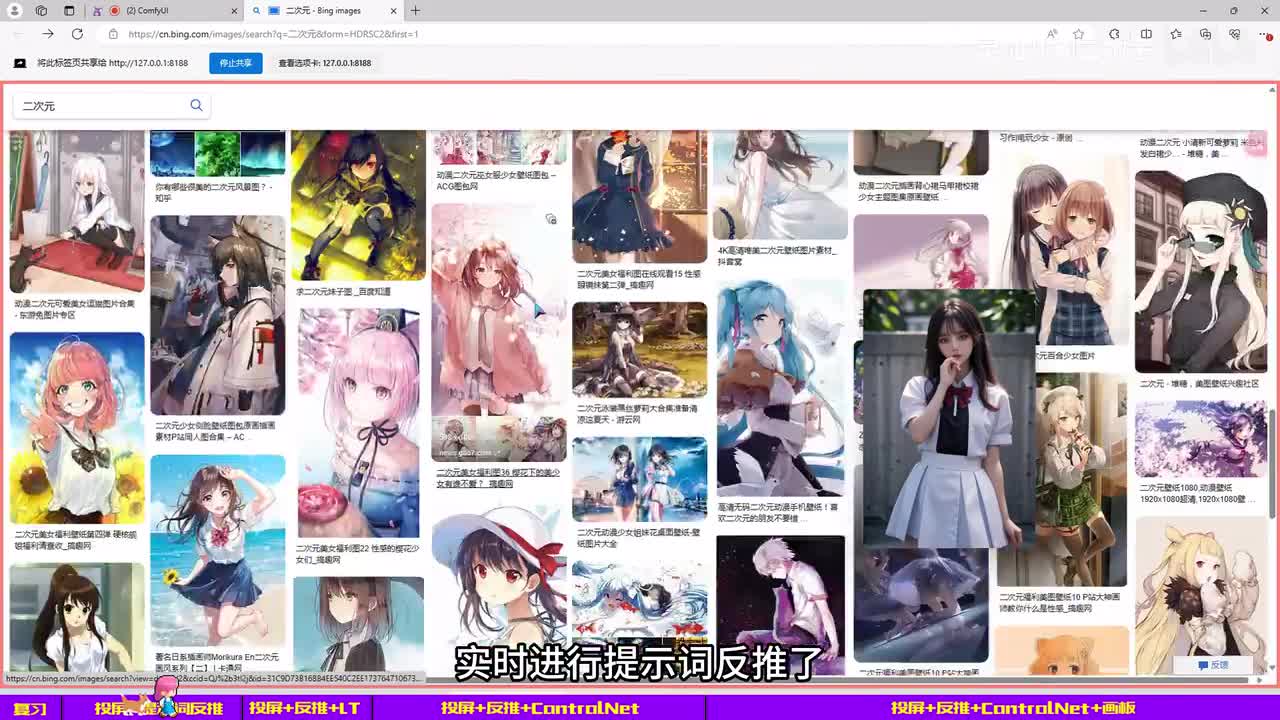

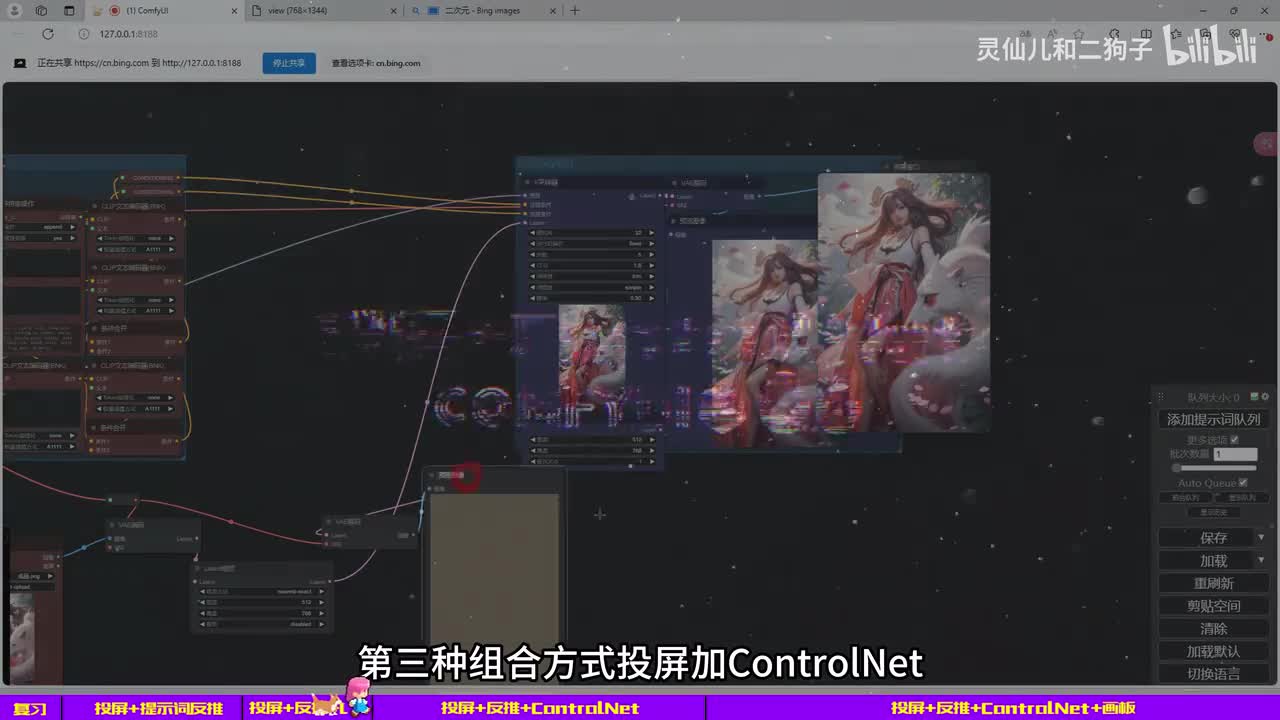

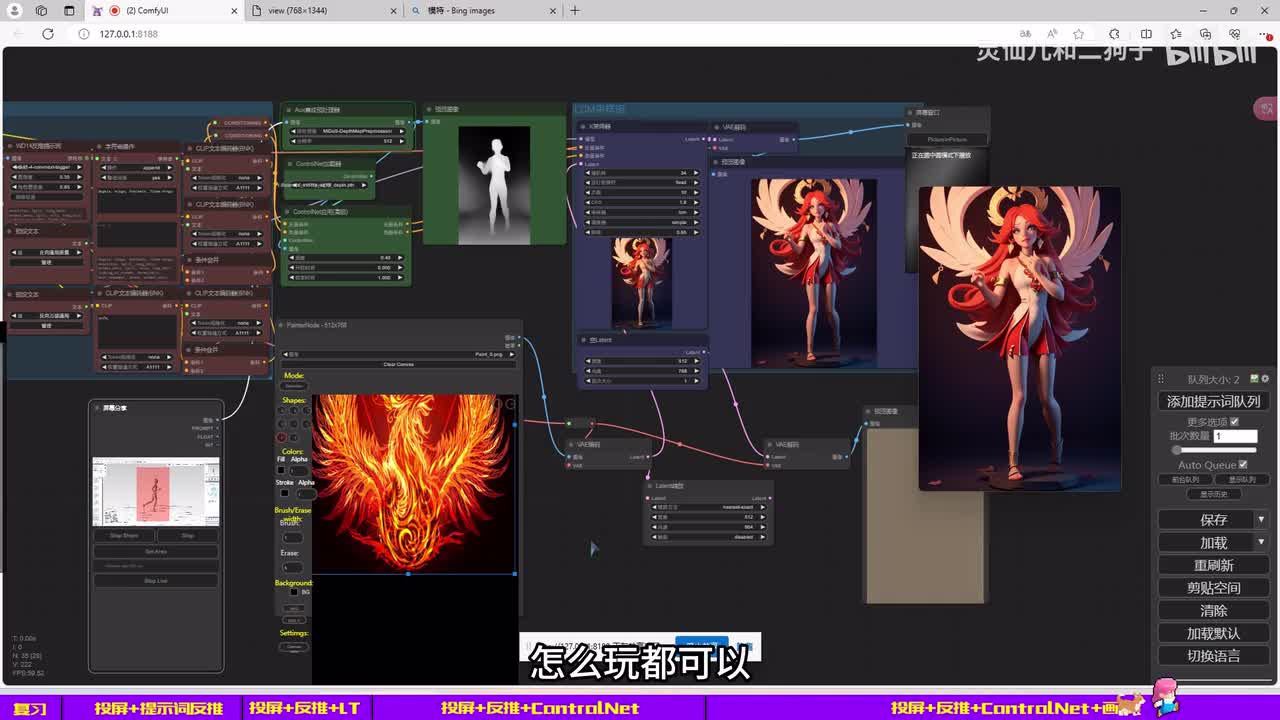

而之前二狗子讲过,我们学习康复u i的目的是为了搭建高度适配个人工作环境的可控工作流。所以呢本章我们就和二狗子一起来点有趣又实用的操作,看一下在基础篇学习过程中搭建的节点流程,通过不同的组合方式会产生何种化学反应呢?关门大二狗。首先打开我们上一章建立的带有反推提示词的l c m基础工作流,再新建画板节点、投屏节点以及悬浮窗节点,将悬浮窗节点连接至采样区的唯一解码,方便后续的查看键。第一种组合方式,投屏加提示词反推,将投屏节点替换加载图像并连接到w d反推提示词。现在全世界都可以帮我们写提示词了,我们可以选择任意有图像信息的图库。

这里以搜索为例,搜索二次元,选择任意一张图像,并通过投屏节点进行窗口共享。选择投屏区域,点击直播运行,打开悬浮窗好了,现在投屏节点就会根据我们共享的图片信息实时进行提示字反推了。从此以后提示字。再也不是问题,因为ai可以帮我们按照我们指定的参考图像的元素进行提示词的实时书写了。比如我们再需要让s d帮我们绘画一张模特的图像,那我们也只需要找到一张模特的参考图。

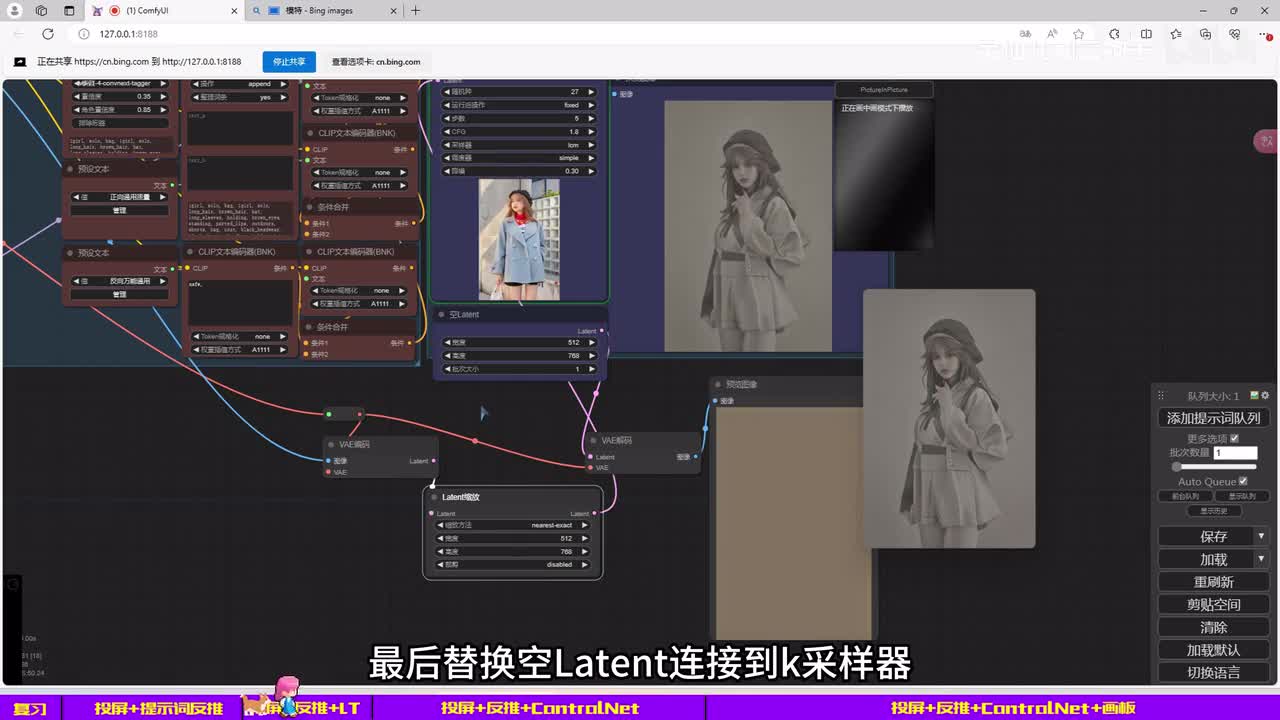

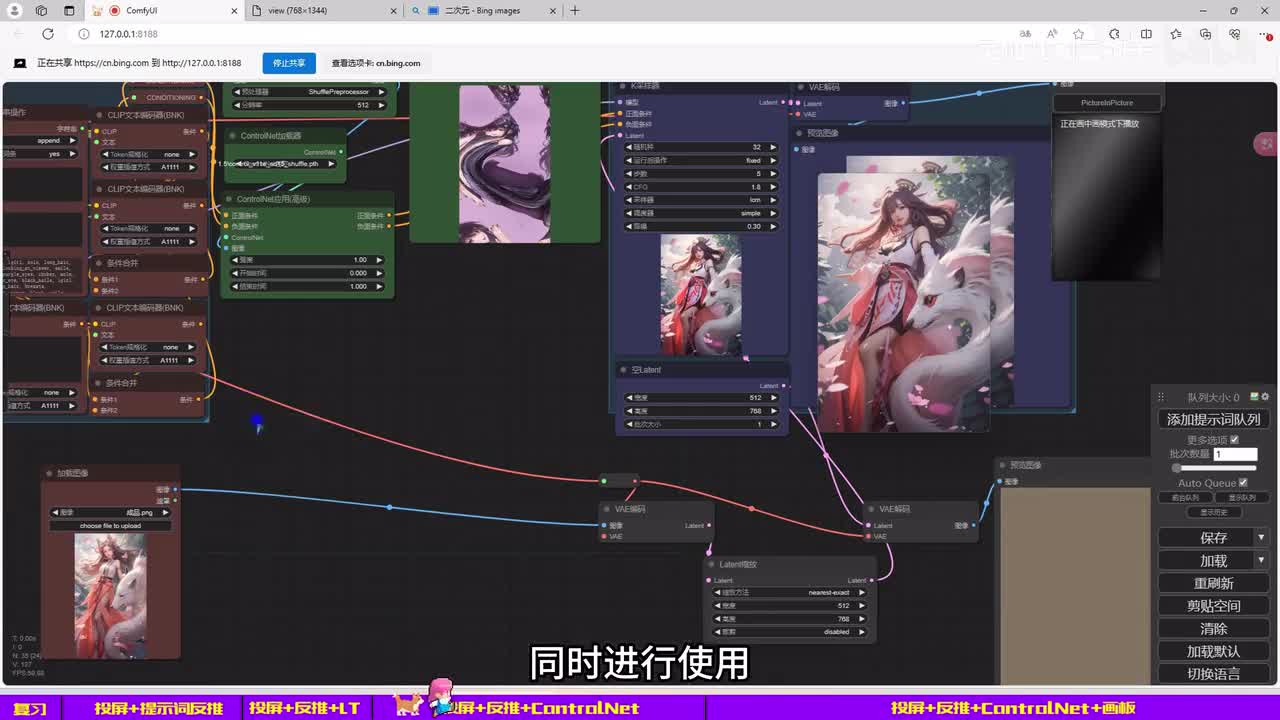

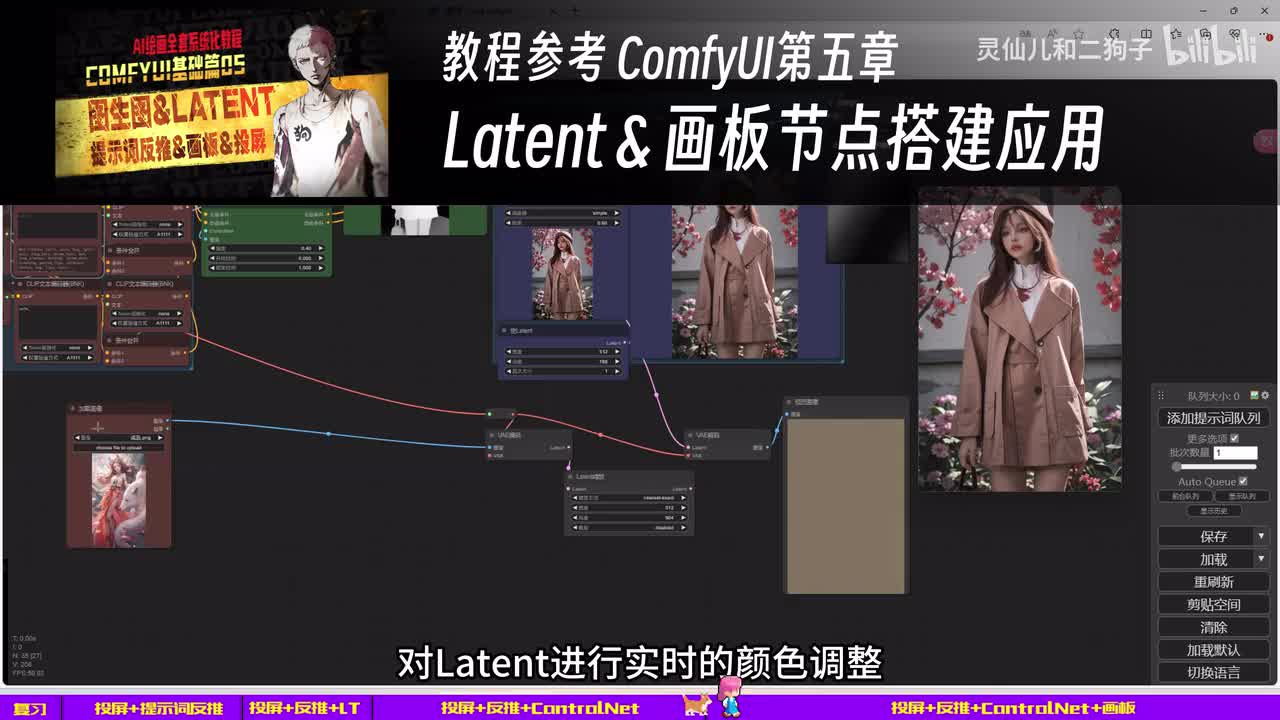

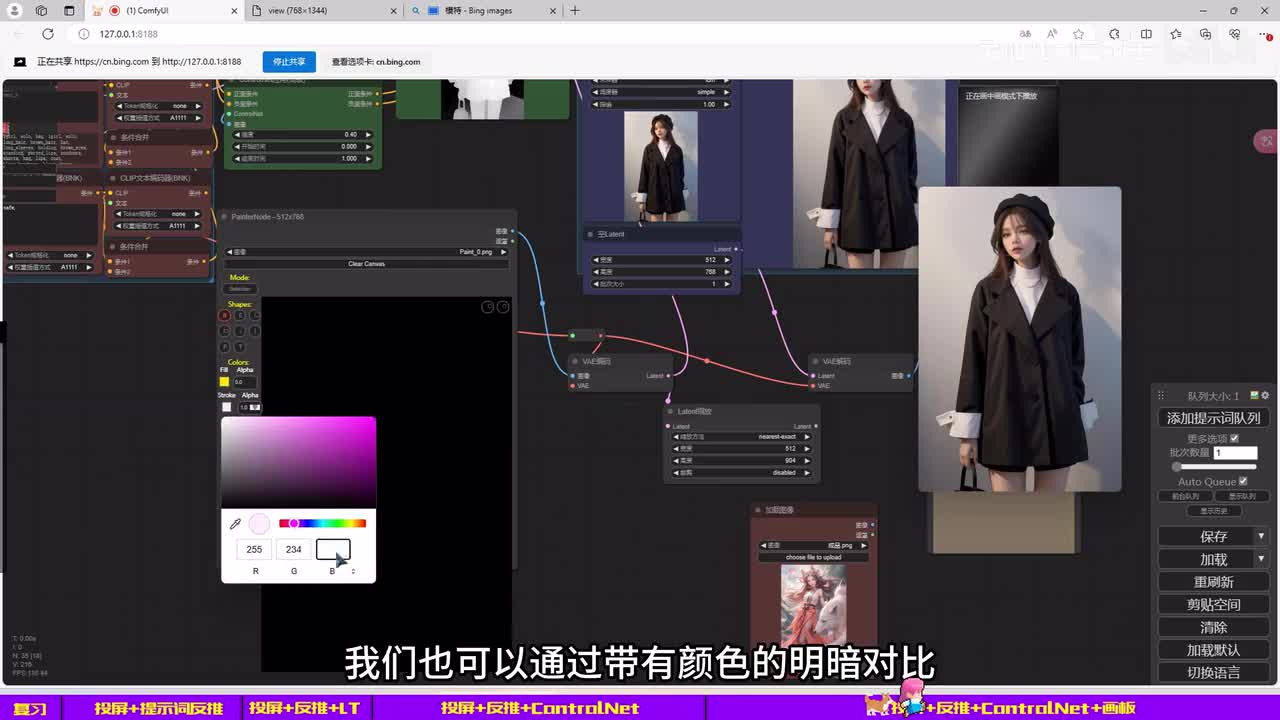

大部分情况下。a i生成的t十四能够具有更强的引导性哦,而我们需要做的仅仅是选择投屏的参考图或者调整随机种子数,就可以轻轻松松让s d扩散出我们需要的图像了。第二种组合方式,投屏加提示词,反推加later取色。之前我们讲过空latten通过解码后是一张褐色图像,所以通过扩散后的图像结果是由褐色加上照片图的颜色进行组。扩散而来。

所以我们也可以通过投屏替换空letter对参考图像进行取色。使用投屏节点的触点连接v一编码器,再将lata进行缩放,缩放到我们需要的尺寸五幺二乘七六八,连接上v一。最后替换connect连接到k太阳系。现在我们就可以通过调整降噪幅度,控制参考图的相似度以及我们需要调取的颜色了。当然我们也可以将投屏的letter直接换为加载图像,通过投屏。

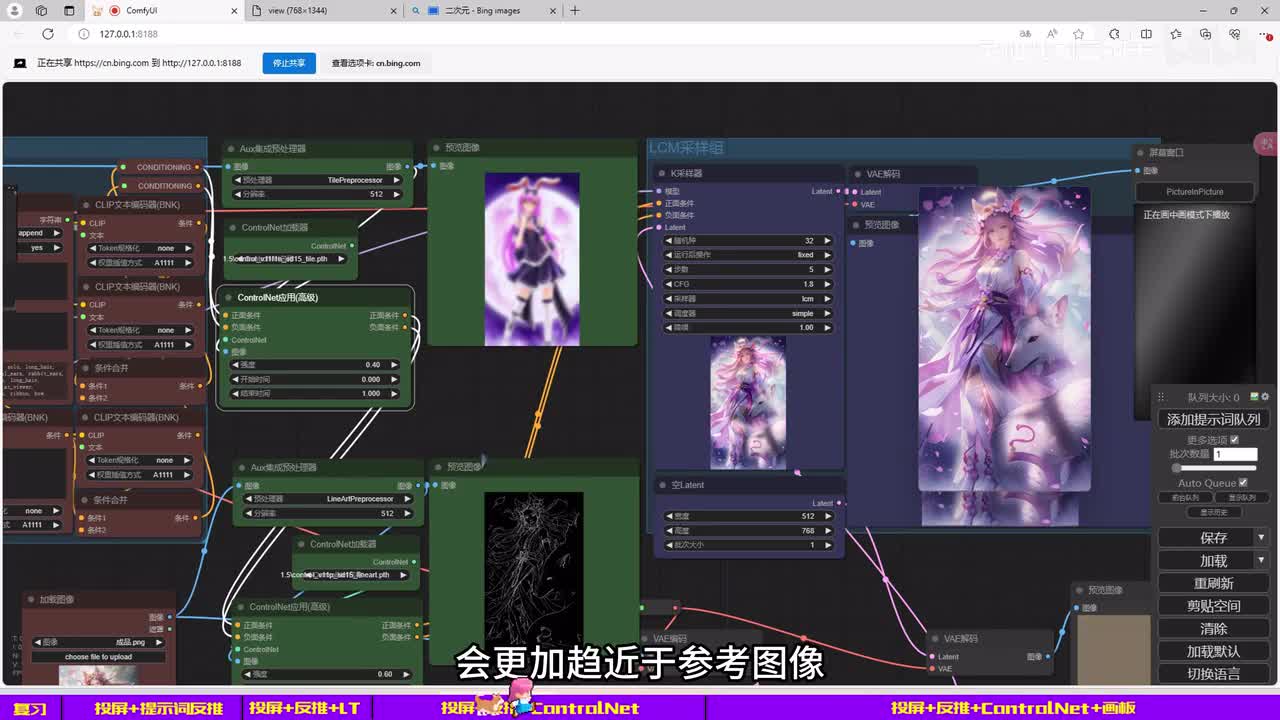

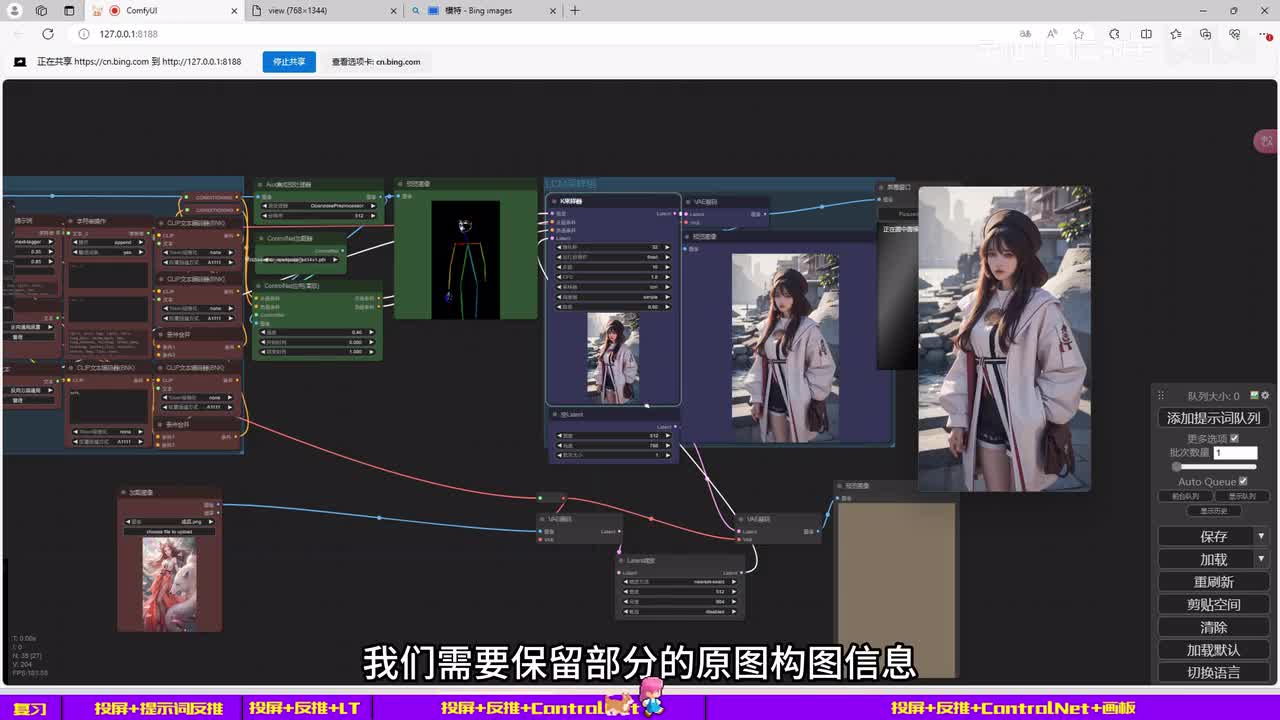

提示词与降噪幅度对上传的图像进行部分的元素修改。比如将舞女的流沙群改为j k裙s d就会根据我们投屏的图像元素反推对应的提示词,进行图像的元素。第三种组合方式,投屏加control l t只要是图像就可以输入到任何需要图像的路径当中。投屏的交互l c m加速加上controlled控制这样多功能的a i i绘画软件是我们使用用t e l l的唯一理由。所以现在我们可以将投屏节点连接到control l t进行实时控图了。

比如借助投屏节点,使用参考图像的提示子元素和构图信息,通过调整降噪幅度完成与上传图像的颜色耦合。或者直接使用随机洗牌,随机打乱原图的色彩分布并注入到unlike在扩散过程中影响图像的颜色,一般可以配合构图类的control lt同时进行使用。比如再建立一组control t调整位置,选择线稿。提取加载图像的线条信息,连接好缺失连线,调整降噪幅度。现在我们就可以完成投屏,参考图的颜色与加载图像的构图进行结合扩散呢,调整一下内存尺寸,与上传的图像尺寸比例一致,效果会更好哦。

接下来就只需要通过投屏节点选择不同的参考图进行取色耦合就可以了。当然使用tile的预处理器直接对图像进行预处理,通过模糊投屏图像也可以直接作为随机洗牌的颜色输入。结构的颜色分布会更加趋近于参考图像,但记得不要更换随机洗牌的模型,因为一旦更换后,就变成了输入颜色和构图信息的风格转换了。另外由于使用l c m在图像质量方面有一定损失,尤其是在工作流中加入了c r r l t后。图像污染的情况会加大。

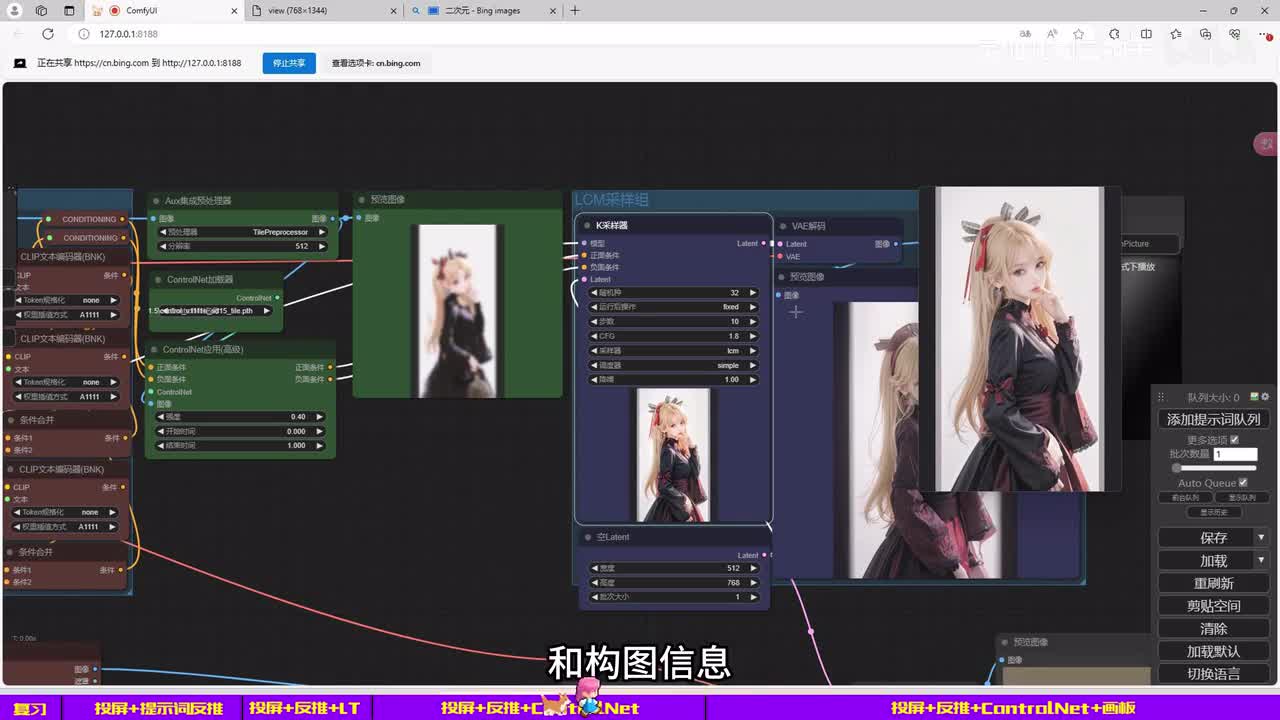

我们也可以通过增加迭代步数,提升图像扩散结果的质量哦,比如将常用的五步迭代替换为十步,图像的质量就会有明显的提升。当然如果我们不需要提取参考图的色彩和。构图信息我们也可以使用open pose进行实时的姿态提取。再次将参考图切换到写实的模特类别,并选择一张模特图像作为投屏参考图。将预处理器选择为open n o s,现在就可以利用投屏的参考图。

只是提取参考图的姿态信息,而不带有其他的构图信息和色彩信息了。而除了更换随机种子数,同样我们使用空latin或者上传图像的方式更换latin的地图,也可以得到不同的抽卡结果。而如果我们需要保留部分的原图构图信息,比如人物的。服装造型我们也可以将control light切换为深度,最大限度的保留人物的服装造型特征,但是不提取参考图的颜色信息。在康复u i中只要你能想到所有的。

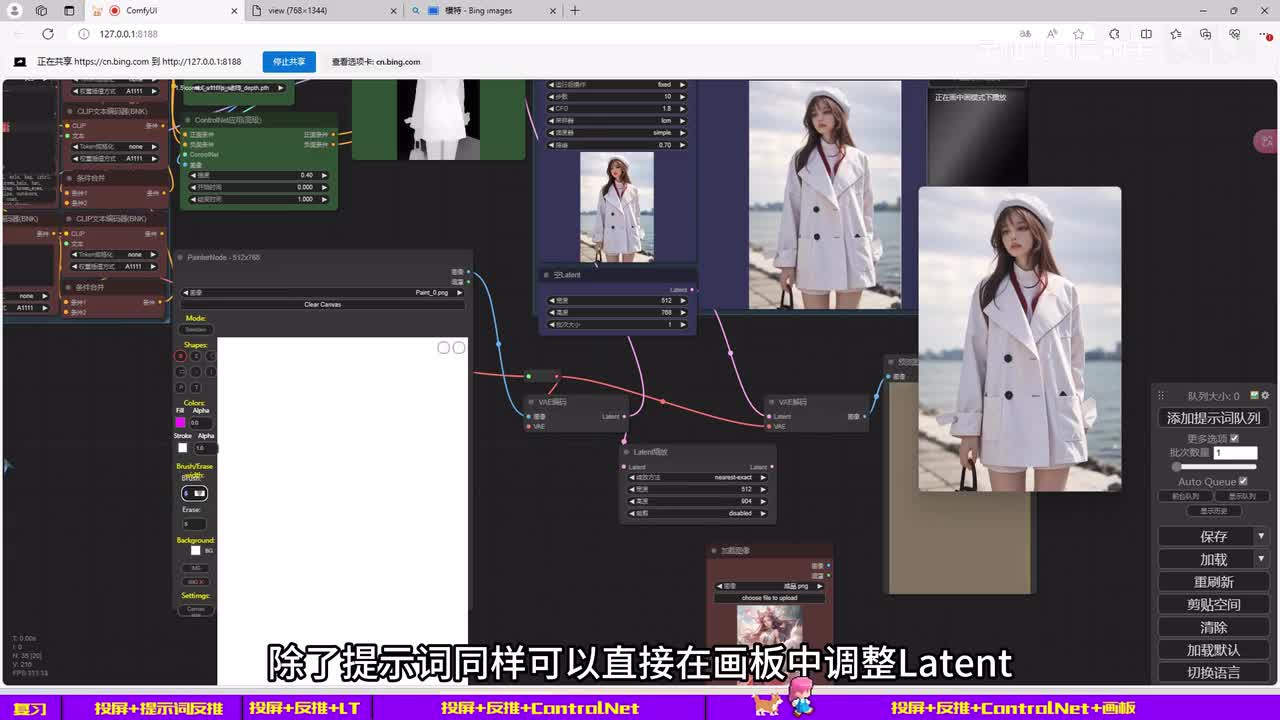

任何方式都是。第四种组合方式,投屏加画板加control lt一般情况下我们可以通过增加提示词对颜色进行微调,比如增加红色的衣服,但由于随机噪声图产生的s d蝴蝶效应,扩散结果的颜色并不是那么容易控制。所以现在我们可以加入画板节点,对letter进行实时的颜色调整,以达到微调颜色的目的。现在将画板节点的画布调整为五幺二乘七六八,并通过v一编码转换为letter输入到黑采集器中。我们会发现现在图像的结果颜色会偏暗,这就是因为我们使用了黑色的later作为扩散底图产生的耦合结果。

现在将降噪幅度调整为零点七,保留大部分的later影响度,再将画布调整为白色。结果就会变亚瑟了。所以想要调整衣服的颜色,除了提示词,同样可以直接在画板中调整meta对应人物服装区域的颜色。随着我们涂抹的红色越来越多,那么对图像扩散结构的影响也就越大。我们也可以先用提示词给图像设置一个背景,输入户外。

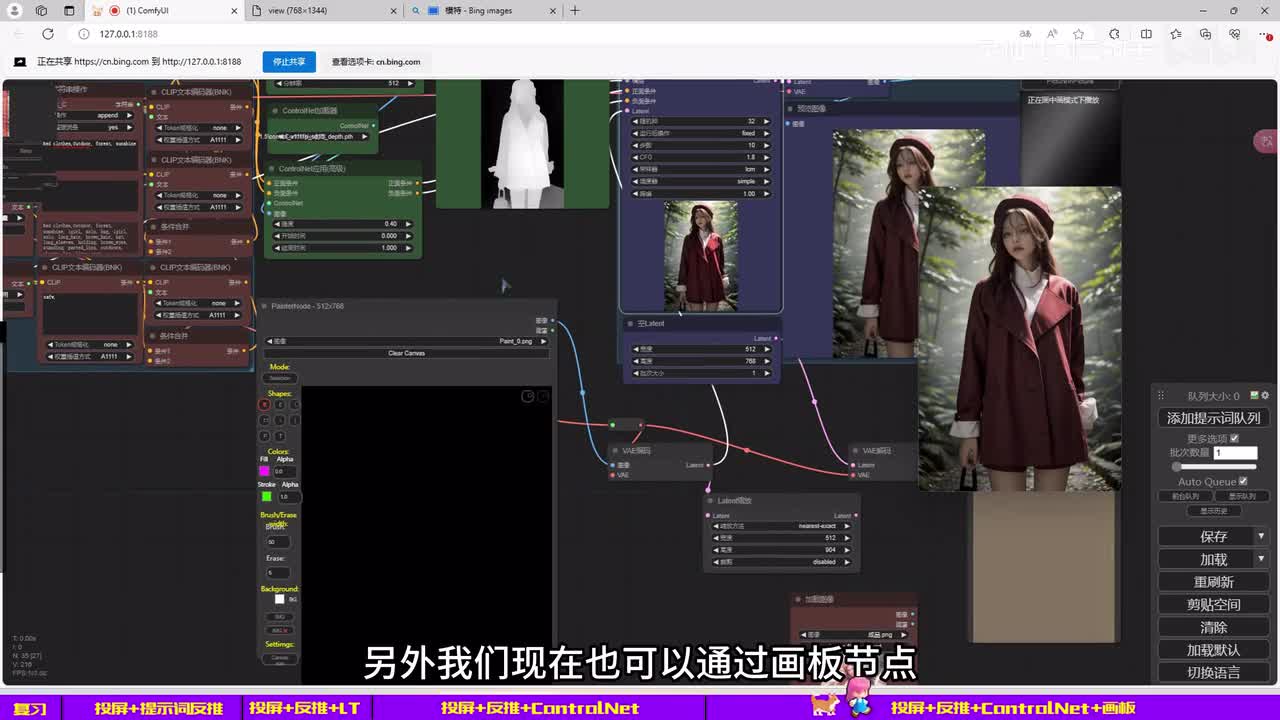

森林阳光对应的元素已经出来了,不过我们希望森林是绿色,所以也可以在对应的区域涂上绿色。当然我们也可以加大降噪幅度,完全将颜色交由提示词控制,不过出现偏色的可能。更大哦。另外我们现在也可以通过画板节点,通过调整letter的明暗对比,引导光源出现的位置。现在的图像光源在人物的背后,我们可以通过黑白的明暗对比涂抹,将光源控制在白色的位置。

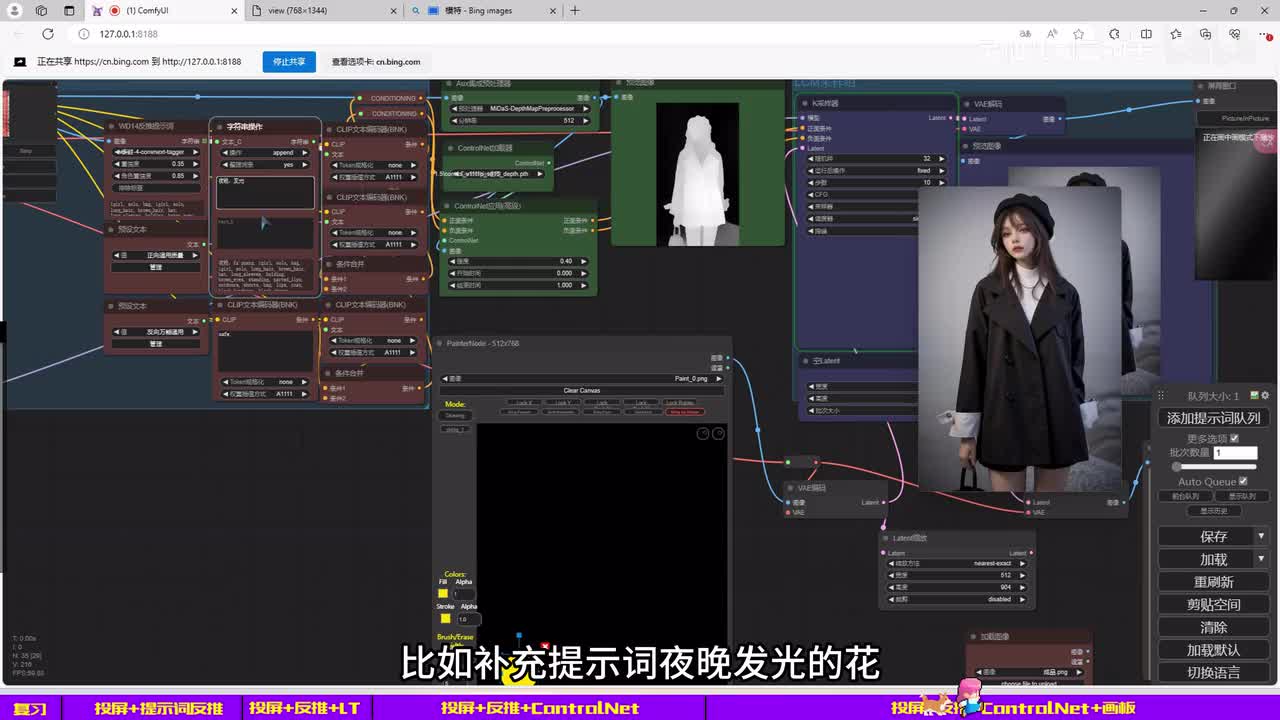

无论如何选择随机种子细节会变,但光源的位置都会固定在左上角。现在删除补充的提取词,将画笔和填充设置为黄色。我们也可以通过带有颜色的明暗对比控制光源的位置。调整降噪幅度,光源出现在了黄色的位置。将黄色拖到右边,光源仍然会出现在黄色的位置。

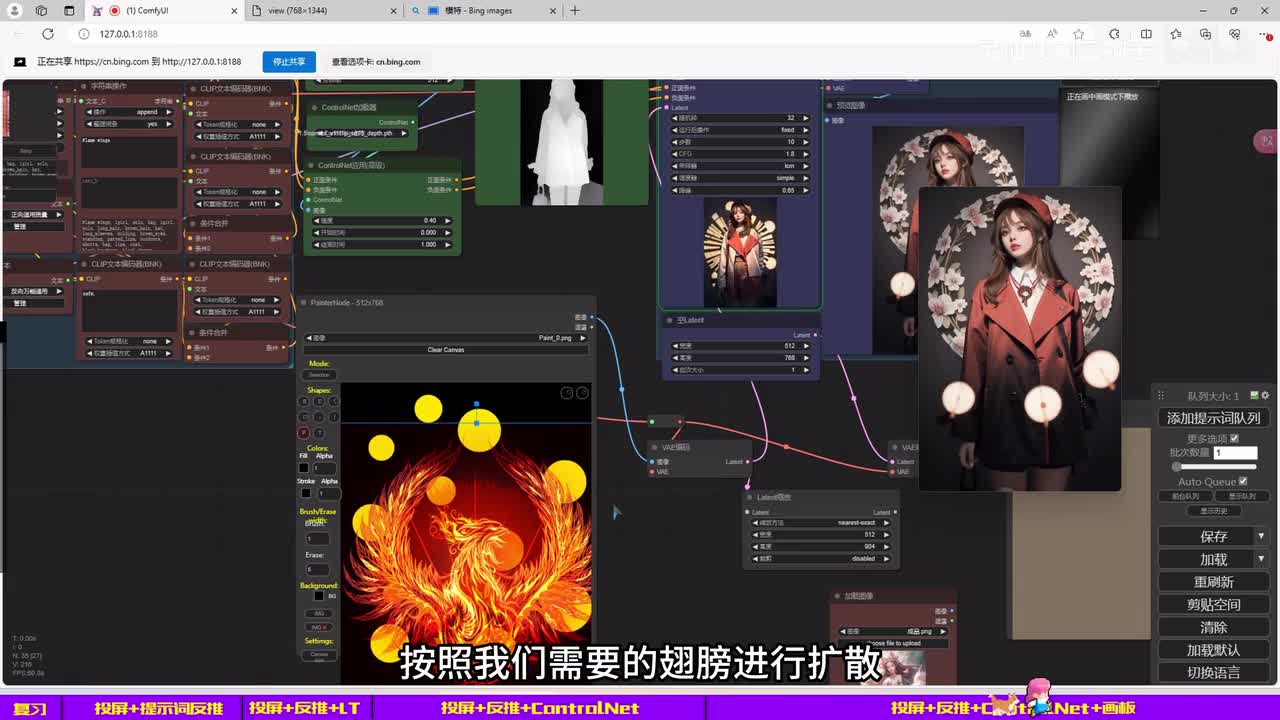

但当我们将光源拖动到下方的时候,会发现光源不见了。这也是s d的耦合效应。按照它的训练数据,仅仅通过latin它没有办法推理出下方黄色是什么东西,所以就会被扩散的噪声图颜色取缔。这个时候我们只需要给他一点引导,比如补充提示词夜晚发光的花,通过提示词的引导加上latent的颜色引导,他就可以理解我们需要的是什么了,哪怕是一朵现实中不存在的发光的花。而除了手动更改latin达到控制图像生成的目的,我们也可以直接上传元素图像。

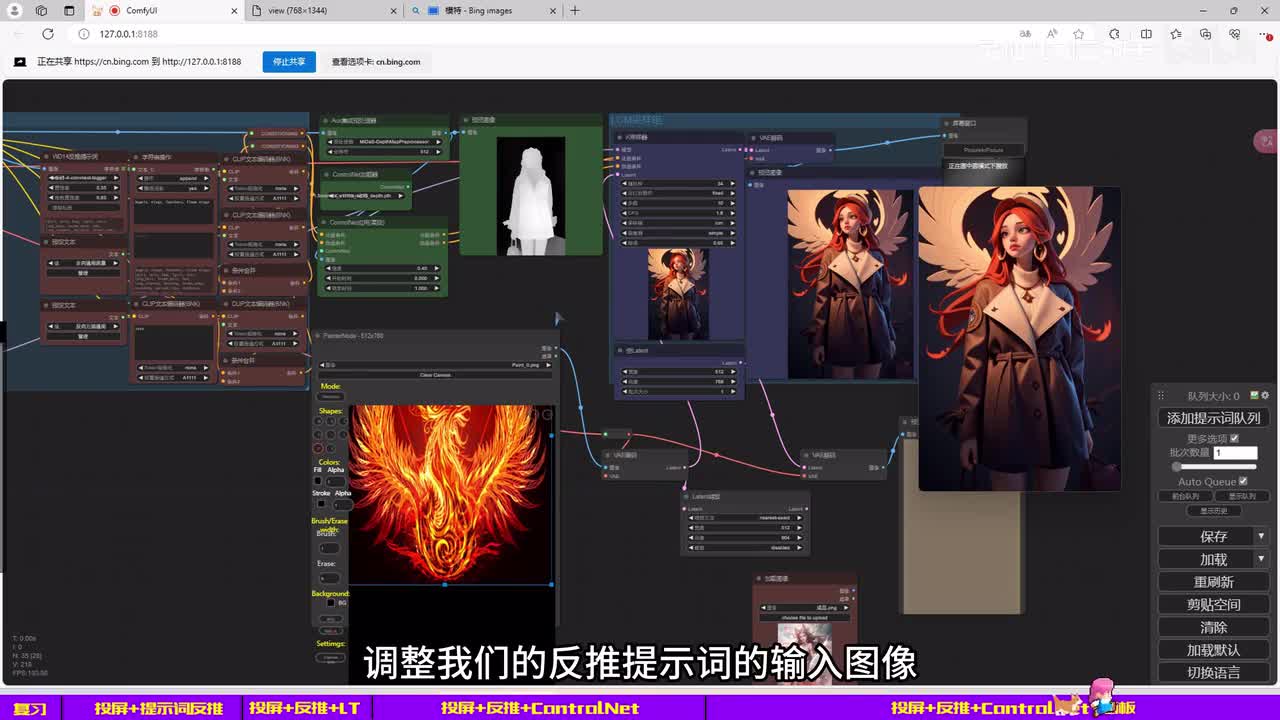

比如上传一张凤凰图腾,现在我们就可以借助它给人物生成一对翅膀,输入补充提示词。火焰翅膀更改降噪幅度执行扩散任务后,可以看到letton已经对结果图像的构图产生了影响,但结果并没有按照我们需要的翅膀进行扩散,说明降噪幅度已经没有问题。那就是提示词或者latin的问题,修改提示词。增加翅膀的提示词元素,天使翅膀、羽毛、火焰翅膀,再清空画板,去除黄色的污染源,单独上传凤凰图腾。ok翅膀已经出现了。

但是受到大模型和随机噪声图的影响,并没有我们想要的效果。所以我们可以通过切换模型,比如换位三d模型。现在一对凤翼就出现在人物身后了,同样可以调整我们的反推提示词的输入图像,将投屏的模特参考图换为上传的狐狸图像,通过不同提示词的引导从而改变人物特征。当然关于图像的优化。与风格定制是我们中阶篇中需要继续学习的内容。

只要有足够强大的初稿控制能力,后续的图像优化、细节提升、风格转换通通都是小问题。而如果需要更改人物的姿态,也可以通过投屏节点与人物模型软件。进行实时互动,从而实时控制结果中的人物姿态,只要你能想到怎么玩都可以。或者更换背景图的颜色,调整画布的颜色蓝色、绿色,或者调整control list的控制网类型,减少构图信息的输入,给s d多一点发挥空间。剩余的就是按照需求切换大模型,更改罗拉提示词等等等等。

当然以上的组合方式仅仅是众多组合中的冰山一角,我们还可以和更多我们没有提到的控制网进行组合。但是我们必须要对基础的节点,基础的扩散原理有足够的了解,才能让我们随心所欲的对不同节点进行组合搭建。这才是我们为什么要从基础开始学习的目的,在s d的学习之路奔跑,而不是在s d的学习之路。追赶。

刺鸟图文助手

刺鸟图文助手