我叫demo是一名阿里云程序员。我没有美术和编导基础,但我做的短片被大神a k转发到推特,斩获了十多万浏览量。大家不妨猜一猜这条视频是用什么软件做的。

好,现在公布答案是阿里云的开源模型image to video generation x l。这个视频从无到有,甚至只用了两分钟。哎,肯定有人说这么一个小片段能干啥呀?视频不只是拍画面,还要在前期策划脚本,后期做好剪辑当导演,哪有这么简单呢?别急,我们不光开源了image to video generation x l,还专门打造了一个工具进入摩达创空间。

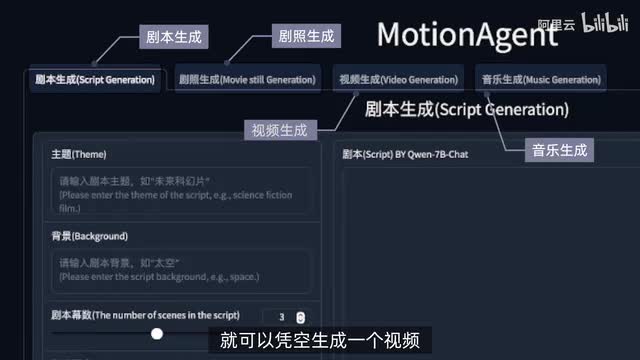

这个叫motion agent的a i应用,可以一键生成剧本、剧照、视频、音乐。你只需要提出一个小小的想法,就可以凭空生成一个视频。接下来我就给大家做个演示。

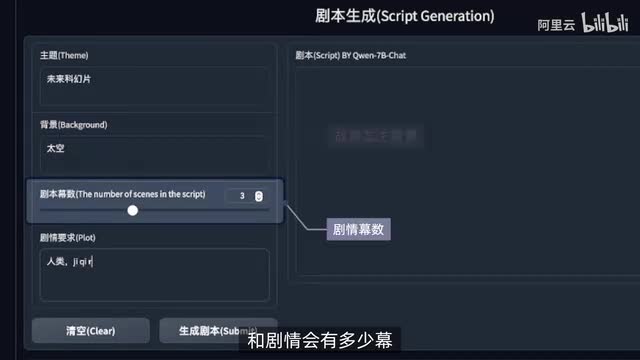

第一步我们先生成剧本。这里集成的大圆模型是先问七b chat,就像这样先填上故事的主题,故事发生的背景和剧情会有多少幕,千问就会直接为我们生成剧本。如果你觉得这个剧本简单,还可以在prompt这里多添一点细节,多生成题目,就像这样。

剧本是不是瞬间丰富了?在生成好剧本之后,我们就可以直接复制到第二个部分来生成剧照。文生图部分使用的是stability最新的x d x l模型,对比旧版在可控性和稳定性上都有很大的进步。我们把刚刚剧本生成的内容粘贴过来,先让前面帮我们生成prompt。

如果你不满意这个图片,就可以用我们放在最下方的提示词助手,从里面选择我们想要的角度和风格,让它给我们提供更丰富的效果。甚至不使用laura,只用prompt就可以实现自由的风格转换,是不是很赞。接下来就是我们的重头戏了,这个image to video generation excel的部分是阿里云自研的一个视频生成模型。

它的工作流程分为两步。第一步先根据我们上传的图片,把出版的低分辨率视频生成出来。这一步在保证于一致性的同时,生成推拉镜头、横移镜头、升降镜头等等各种各样的稳定的镜头。

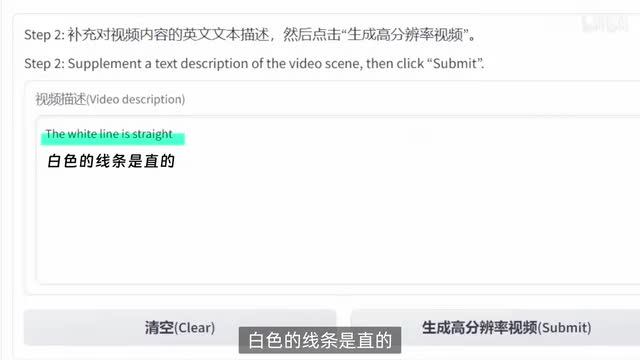

如果不满意就可以一直生成。因为是低分辨率视频,所以生成速度还是挺快的。第二步就是用prompt去描述刚刚的视频,让ai理解我们刚刚生成了什么东西。

通过我们提示词的干预,a i就会通过逆运算在原本的视频上去除噪点,提高视频的分辨率和时空一致性。简单来说就是通过提示词去约束它,让它针对性的去优化我们刚刚的视频,让视频的效果更好。如果你嫌英文的prompt太麻烦,就可以直接复制刚刚生成图像用的prompt。

比如在这里我生成了一个跑道的视频,但是a i不理解跑道的线条是直的,所以生成的视频里跑道变成了蚯蚓。我们只用在这里补上一句,白色的线条是直的,大家看是不是瞬间就好了。当然短片怎么能缺了背景音乐呢?这个工具还为大家整合了音乐生成的模型。

我们只需要填入简短的提示词,然后选择长度就可以得到一个用于剪辑的配乐,完全没有操作门槛。这里就放一个片段给大家感受一下生成效果。到了这里,我也把视频全部生成好了,大家来看看效果吧。

就这个片子把周围的程序员羡慕坏了。虽然这些彩虹屁让我飘飘欲仙,但是我这种没有美术和编导基础的人都能做成这样。那这给b站的宝子们不是起飞了。

人人都能成为艺术家的时代到了。大家快来阿里云和我们一起生成你的第一部a i g c短片吧。

刺鸟图文助手

刺鸟图文助手